人工智能與大數據 從技術共舞到未來融合

人工智能(AI)已滲透到醫療、金融、教育、交通等各個領域,成為推動社會變革的重要力量。作為AI核心燃料的“大數據”,其價值、運作機制和倫理挑戰,在公眾認知中仍存在顯著空白。這種認知上的不對稱,為未來計算機領域的技術開發提出了新的課題與方向。

一、現狀:AI的顯性崛起與大數據的隱性支撐

人工智能的應用已隨處可見:從手機上的語音助手、推薦算法,到自動駕駛汽車和醫療影像診斷系統。這些應用的背后,是海量、高質量的數據在驅動模型的訓練與優化。公眾往往只驚嘆于AI的“智能”表現,卻對數據如何被收集、清洗、標注、處理和分析知之甚少。這種不了解可能導致兩方面問題:一是對AI能力的盲目信任或恐懼;二是對個人數據權利和隱私風險的忽視。

二、核心挑戰:彌合認知與技術鴻溝

未來的技術開發必須正視并解決這一矛盾:

- 數據素養的普及:技術開發不應只局限于算法優化。開發更直觀、透明的數據可視化工具和公眾教育平臺,讓非專業人士也能理解數據如何影響AI決策,將成為重要方向。例如,在AI輔助醫療診斷系統中,向醫生和患者清晰展示是哪些數據特征導致了診斷建議。

- 隱私計算技術的突破:人們對大數據的不了解與不信任,很大程度上源于對隱私泄露的擔憂。因此,聯邦學習、差分隱私、同態加密、安全多方計算等隱私計算技術將成為研發熱點。目標是實現“數據可用不可見”,在充分利用數據價值的從技術層面保障數據安全與合規。

- 小數據與高效學習:過度依賴大數據集存在成本高、能耗大、隱私風險多等弊端。開發更高效的機器學習算法(如小樣本學習、元學習、自監督學習),讓AI能從更少、更精的數據中學習,是降低技術門檻和依賴度的關鍵。

- 數據治理與AI倫理的嵌入式開發:技術開發必須將倫理原則前置。這意味著在系統設計之初,就內置公平性檢測、可解釋性模塊、算法審計接口和問責機制。開發能夠自動識別和緩解數據偏見(如性別、種族偏見)的工具,將成為標準配置。

三、未來趨勢:邁向“智能數據”與“人本AI”

未來的發展將不再僅僅是AI或大數據單方面的突進,而是二者的深度融合,并最終服務于人:

- 從“大數據”到“智能數據”:技術重點將從單純的數據規模擴張,轉向數據的質量、時效性與知識密度。AI將不僅消費數據,更將主動管理和生成高質量合成數據,形成良性循環。

- 領域專家與AI的深度協作:在醫療、科研等專業領域,開發“以人為中心”的AI工具,讓領域專家能將其專業知識與AI的數據處理能力無縫結合,共同解決復雜問題,而不是被AI替代。

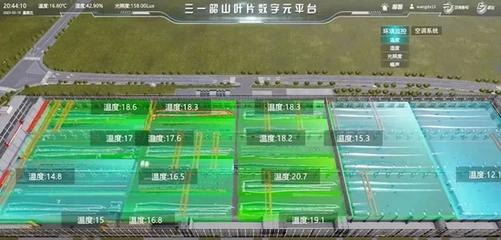

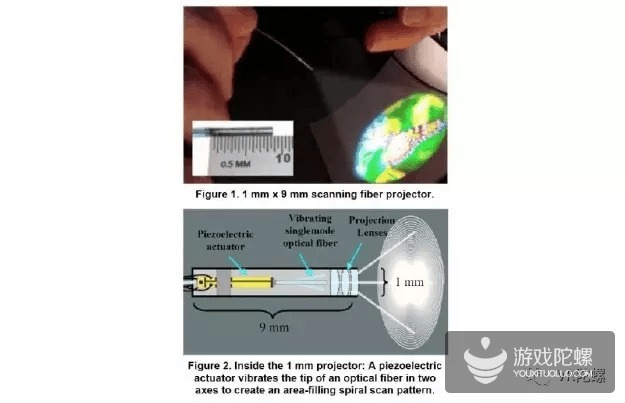

- 邊緣智能的普及:隨著物聯網和5G/6G技術的發展,更多的數據處理和AI推理將在數據產生的源頭(邊緣設備)完成。這既能減少數據傳輸壓力、提升實時性,也能在本地更好地保護隱私。

- 通用人工智能(AGI)的漫長探索:當前AI主要是針對特定任務的“窄AI”。對大數據背后通用規律和因果關系的探索,將是通向更高級智能形態的必經之路,但這需要基礎理論(如神經科學、認知科學)與計算技術的共同突破。

結論

人工智能的“顯性”成功與大數據知識的“隱性”缺失,揭示了技術發展與社會認知之間的斷層。未來計算機領域的技術開發,必須承擔起彌合這一斷層的責任。其路徑將是從追求純粹的算力與規模,轉向構建更高效、更可信、更透明、更以人為本的技術體系。只有當公眾對支撐AI的數據有了基本了解與信任,只有當技術開發者將倫理與社會責任內化于代碼之中,人工智能才能真正健康、可持續地賦能人類未來。

如若轉載,請注明出處:http://www.isabela.com.cn/product/4.html

更新時間:2026-01-05 00:34:52